intel 10nm ice lake十代酷睿处理器已经上市,但它可不仅仅会用于轻薄笔记本,未来还会登陆服务器,而在两个月前以色列海法(intel重要研发基地),intel还展示了

hot chips 31芯片大会上,intel首次公布了这款特殊产品的架构细节。

在无处不ai(ai everywhere)的指导思想下,intel正在研究各种各样的ai软硬件方案,包括cpu、gpu、fpga、asic等等。

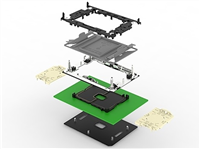

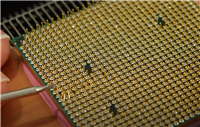

这款新的nnp-i代号为“spring hill”(温泉山丘),面向数据中心领域的轻度ai推理工作,能做成m.2扩展卡正是得益于10nm芯片的超小面积。

在原有10nm ice lake处理器的基础上,intel拿掉了两个cpu计算核心、gpu核芯显卡,同时加入12个推理计算引擎(ice),彼此基于硬件同步,同时每个ice有自己的4mb sram缓存来减少数据转移,并且和两个cpu核心共享一致性互连、24mb三级缓存。

intel还设计了一个深度学习计算网格(dl compute grid),作为张量引擎的它通过数据和控制总线与sram、vp6 dsp互连,支持fp16、int8、int4、int2、int1等类型操作,其中dsp还可以处理一些特殊的算法。

cpu核心仍然是标准的sunny cove架构,支持avx-512、vnni指令集,可加速卷积神经网络,而完全继承的fivr电压调节器可动态调整功耗,优先满足最需要的硬件单元。

内置两个lpddr4x内存控制器,整合封装一颗内存芯片与之配合,传输带宽4.2gt/s(68gb/s),并支持带内ecc,但容量未公布。

nnp-i与系统的通信通道走的是pcie 3.0 x4或者pcie 3.0 x8,带宽不是事儿,但没有用nvme协议,只是标准的pcie界面。

tdp功耗非常灵活,低可至10w,高可达50w,完全视性能需要而定,作为扩展卡也不受m.2 15w的限制。根据不同功耗配置,int8整数能效在2-4.8top/s范围内。

intel表示,10w tdp功耗下跑resnet500,每分钟推理数可达3600,等于效率高达4.8top/s,还是相当高的。

软件方面,intel会提供相应的开发工具,帮助负载将推理工作完全转移到加速器上,完成后再通知至强cpu进行下一步处理,从而使得至强cpu不再需要通过pcie总线和其他加速器彼此通信、转移数据,大大节省计算资源和功耗。

intel nnp-i目前已经试产,将在年底投入规模量产并出货,而且后续还有两代新品正在设计中……

如对本文有疑问, 点击进行留言回复!!

2年升级一次 Intel:10nm、7nm及5nm工艺开发不会削减投资

AMD推土机FX-8350超频至8.1GHz!却打不过3.6GHz锐龙

网友评论