电解铜,撒萌萌照片,金瑞希

今天在爬知乎精华时,出现了‘forbidden by robots.txt’的问题

了解到到scrapy在爬取设定的url之前,它会先向服务器根目录请求一个txt文件,这个文件规定了爬取范围

scrapy会遵守这个范围协议,查看自己是否符合权限,出错说明不符合,所以我们只要不遵守这个协议就ok了

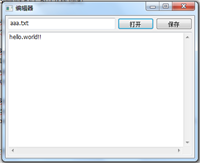

在settings.py中找到 robotsstxt_obey 改

robotstxt_obey=false

问题就解决了。

如对本文有疑问,请在下面进行留言讨论,广大热心网友会与你互动!! 点击进行留言回复

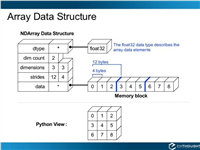

Python 实现将numpy中的nan和inf,nan替换成对应的均值

python爬虫把url链接编码成gbk2312格式过程解析

网友评论