龙岩分类信息,魏县网,风笛官网

初识python爬虫

互联网

简单来说互联网是由一个个站点和网络设备组成的大网,我们通过浏览器访问站点,站点把html、js、css代码返回给浏览器,这些代码经过浏览器解析、渲染,将丰富多彩的网页呈现我们眼前;

一、什么是爬虫

网络爬虫(又被称为网页蜘蛛,网络机器人,在foaf社区中间,更经常的称为网页追逐者),是一种按照一定的规则,自动地抓取万维网信息的程序或者脚本。另外一些不常使用的名字还有蚂蚁、自动索引、模拟程序或者蠕虫。

如果我们把互联网比作一张大的蜘蛛网,数据便是存放于蜘蛛网的各个节点,而爬虫就是一只小蜘蛛,沿着网络抓取自己的猎物(数据)

爬虫指的是:向网站发起请求,获取资源后分析并提取有用数据的程序;

从技术层面来说就是 通过程序模拟浏览器请求站点的行为,把站点返回的html代码/json数据/二进制数据(图片、视频) 爬到本地,进而提取自己需要的数据,存放起来使用;

二、爬虫的基本流程:

用户获取网络数据的方式:

方式1:浏览器提交请求--->下载网页代码--->解析成页面

方式2:模拟浏览器发送请求(获取网页代码)->提取有用的数据->存放于数据库或文件中

爬虫要做的就是方式2;

其实,爬虫的过程和浏览器浏览网页的过程是一样的。道理大家应该都明白,就是当我们在键盘上输入网址点击搜索之后,通过网络首先会经过dns服务器,分析网址的域名,找到了真正的服务器。然后我们通过http协议对服务器发出get或post请求,若请求成功,我们就得到了我们想看到的网页,一般都是用html, css, js等前端技术来构建的,若请求不成功,服务器会返回给我们请求失败的状态码,常见到的503,403等。

1、发起请求

使用http库向目标站点发起请求,即发送一个request

request包含:请求头、请求体等

request模块缺陷:不能执行js 和css 代码

2、获取响应内容

如果服务器能正常响应,则会得到一个response

response包含:html,json,图片,视频等

3、解析内容

解析html数据:正则表达式(re模块),第三方解析库如beautifulsoup,pyquery等

解析json数据:json模块

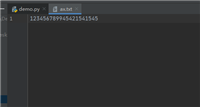

解析二进制数据:以wb的方式写入文件

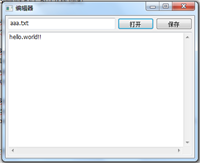

4、保存数据

数据库(mysql,mongdb、redis)

文件

三、、 request

1、请求方式:

2、请求的url

url编码

3、请求头

4、请求体

请求体

总结爬虫流程:

互联网

简单来说互联网是由一个个站点和网络设备组成的大网,我们通过浏览器访问站点,站点把html、js、css代码返回给浏览器,这些代码经过浏览器解析、渲染,将丰富多彩的网页呈现我们眼前;

一、什么是爬虫

网络爬虫(又被称为网页蜘蛛,网络机器人,在foaf社区中间,更经常的称为网页追逐者),是一种按照一定的规则,自动地抓取万维网信息的程序或者脚本。另外一些不常使用的名字还有蚂蚁、自动索引、模拟程序或者蠕虫。

如果我们把互联网比作一张大的蜘蛛网,数据便是存放于蜘蛛网的各个节点,而爬虫就是一只小蜘蛛,沿着网络抓取自己的猎物(数据)

爬虫指的是:向网站发起请求,获取资源后分析并提取有用数据的程序;

从技术层面来说就是 通过程序模拟浏览器请求站点的行为,把站点返回的html代码/json数据/二进制数据(图片、视频) 爬到本地,进而提取自己需要的数据,存放起来使用;

二、爬虫的基本流程:

用户获取网络数据的方式:

方式1:浏览器提交请求—>下载网页代码—>解析成页面

方式2:模拟浏览器发送请求(获取网页代码)->提取有用的数据->存放于数据库或文件中

爬虫要做的就是方式2;

爬虫过程

其实,爬虫的过程和浏览器浏览网页的过程是一样的。道理大家应该都明白,就是当我们在键盘上输入网址点击搜索之后,通过网络首先会经过dns服务器,分析网址的域名,找到了真正的服务器。然后我们通过http协议对服务器发出get或post请求,若请求成功,我们就得到了我们想看到的网页,一般都是用html, css, js等前端技术来构建的,若请求不成功,服务器会返回给我们请求失败的状态码,常见到的503,403等。

1、发起请求

使用http库向目标站点发起请求,即发送一个request

request包含:请求头、请求体等

request模块缺陷:不能执行js 和css 代码

2、获取响应内容

如果服务器能正常响应,则会得到一个response

response包含:html,json,图片,视频等

3、解析内容

解析html数据:正则表达式(re模块),第三方解析库如beautifulsoup,pyquery等

解析json数据:json模块

解析二进制数据:以wb的方式写入文件

4、保存数据

数据库(mysql,mongdb、redis)

文件

三、、 request

1、请求方式:

常见的请求方式:get / post

2、请求的url

url全球统一资源定位符,用来定义互联网上一个唯一的资源 例如:一张图片、一个文件、一段视频都可以用url唯一确定

url编码

网页的加载过程是:

加载一个网页,通常都是先加载document文档,

在解析document文档的时候,遇到链接,则针对超链接发起请求

3、请求头

user-agent:请求头中如果没有user-agent客户端配置,服务端可能将你当做一个非法用户host;

cookies:cookie用来保存登录信息

(1)referrer:访问源至哪里来(一些大型网站,会通过referrer 做防盗链策略;所有爬虫也要注意模拟)

(2)user-agent:访问的浏览器(要加上否则会被当成爬虫程序)

(3)cookie:请求头注意携带

4、请求体

请求体

如果是get方式,请求体没有内容 (get请求的请求体放在 url后面参数中,直接能看到)

如果是post方式,请求体是format data

ps:

1、登录窗口,文件上传等,信息都会被附加到请求体内

2、登录,输入错误的用户名密码,然后提交,就可以看到post,正确登录后页面通常会跳转,无法捕捉到post

总结爬虫流程:

爬取—>解析—>存储

参考博客:

如对本文有疑问,请在下面进行留言讨论,广大热心网友会与你互动!! 点击进行留言回复

Python 实现将numpy中的nan和inf,nan替换成对应的均值

python爬虫把url链接编码成gbk2312格式过程解析

网友评论