强弩之末的意思,柳州工长装修,猫扑美女

例如 具有如下结构的html文件python为我们提供了sgmlparser类,sgmlparser 将 html 分析成 8 类数据[1],然后对每一类调用单独的方法:使用时只需继承sgmlparser 类,并编写页面信息的处理函数。

可用的处理函数如下:

是一个开始一个块的 html 标记,象 <html>,<head>,<body> 或 <pre> 等,或是一个独一的标记,象 <br> 或 <img> 等。当它找到一个开始标记 tagname,sgmlparser 将查找名为 start_tagname 或 do_tagname 的方法。例如,当它找到一个 <pre> 标记,它将查找一个 start_pre 或 do_pre 的方法。如果找到了,sgmlparser 会使用这个标记的属性列表来调用这个方法;否则,它用这个标记的名字和属性列表来调用 unknown_starttag 方法。

是结束一个块的 html 标记,象 </html>,</head>,</body> 或 </pre> 等。当找到一个结束标记时,sgmlparser 将查找名为 end_tagname 的方法。如果找到,sgmlparser 调用这个方法,否则它使用标记的名字来调用 unknown_endtag 。

用字符的十进制或等同的十六进制来表示的转义字符,象 。当找到,sgmlparser 使用十进制或等同的十六进制字符文本来调用 handle_charref 。

html 实体,象 ©。当找到,sgmlparser 使用 html 实体的名字来调用 handle_entityref 。

html 注释, 包括在 <!-- ... -->之间。当找到,sgmlparser 用注释内容来调用 handle_comment。

html 处理指令,包括在 <? ... > 之间。当找到,sgmlparser 用处理指令内容来调用 handle_pi。

html 声明,如 doctype,包括在 <! ... >之间。当找到,sgmlparser 用声明内容来调用 handle_decl。

文本块。不满足其它 7 种类别的任何东西。当找到,sgmlparser 用文本来调用 handle_data。

def end_div(self):#遇到</div>

self.flag = false

def start_p(self, attrs):

if self.flag == false:

return

self.getdata = true

def handle_data(self, text):#处理文本

if self.getdata:

self.idlist.append(text)

上面的思路存在一个bug

遇到</div>后 设置标记flag = false

如果遇到div嵌套怎么办?

在遇到第一个</div>之后标记flag = false,导致无法的到‘感兴趣内容'。

怎么办呢?如何判断遇到的</div>是和<div class='entry-content'>匹配的哪个呢?

很简单,</div>和<div>是对应的,我们可以记录他所处的层数。进入子层div verbatim加1,退出子层div verbatim减1.这样就可以判断是否是同一层了。

修改后 如下

def end_div(self):#遇到</div>

if self.verbatim == 0:

self.flag = false

if self.flag == true:#退出子层div了,层数减1

self.verbatim -=1

def start_p(self, attrs):

if self.flag == false:

return

self.getdata = true

def end_p(self):#遇到</p>

if self.getdata:

self.getdata = false

def handle_data(self, text):#处理文本

if self.getdata:

self.idlist.append(text)

def printid(self):

for i in self.idlist:

print i

最后 建立了我们自己的类getidlist后如何使用呢?

简单建立实例 t = getidlist()

the_page为字符串,内容为html

t.feed(the_page)#对html解析

t.printid()打印出结果

全部测试代码为

def end_div(self):#遇到</div>

if self.verbatim == 0:

self.flag = false

if self.flag == true:#退出子层div了,层数减1

self.verbatim -=1

def start_p(self, attrs):

if self.flag == false:

return

self.getdata = true

def end_p(self):#遇到</p>

if self.getdata:

self.getdata = false

def handle_data(self, text):#处理文本

if self.getdata:

self.idlist.append(text)

def printid(self):

for i in self.idlist:

print i

##import urllib2

##import datetime

##vrg = (datetime.date(2012,2,19) - datetime.date.today()).days

##strurl = 'http://www.nod32id.org/nod32id/%d.html'%(200+vrg)

##req = urllib2.request(strurl)#通过网络获取网页

##response = urllib2.urlopen(req)

##the_page = response.read()

the_page ='''<html>

<head>

<title>test</title>

</head>

<body>

<h1>title</h1>

<div class='entry-content'>

<div class= 'ooxx'>我是来捣乱的</div>

<p>感兴趣内容1</p>

<p>感兴趣内容2</p>

……

<p>感兴趣内容n</p>

<div class= 'ooxx'>我是来捣乱的2<div class= 'ooxx'>我是来捣乱的3</div></div>

</div>

<div class='content'>

<p>内容1</p>

<p>内容2</p>

……

<p>内容n</p>

</div>

</body>

</html>

'''

lister = getidlist()

lister.feed(the_page)

lister.printid()

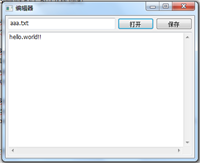

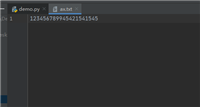

执行后 输出为

如对本文有疑问,请在下面进行留言讨论,广大热心网友会与你互动!! 点击进行留言回复

Python 实现将numpy中的nan和inf,nan替换成对应的均值

python爬虫把url链接编码成gbk2312格式过程解析

网友评论